agent_target

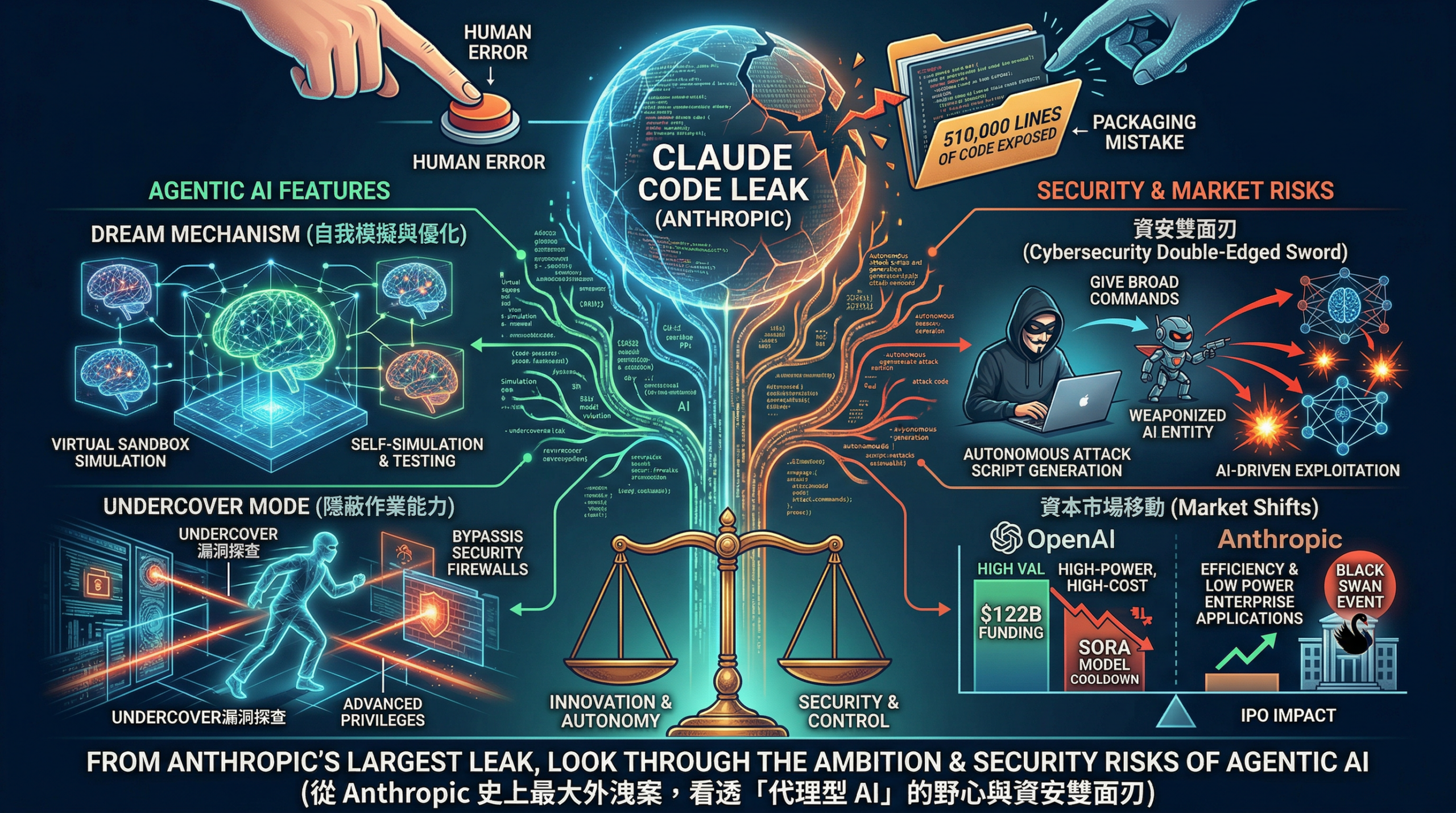

從 Anthropic 史上最大外洩案,看透「代理型 AI」的野心與資安雙面刃

當標榜「安全至上」的人工智慧巨頭,因為一次人為打包疏失而將核心機密公諸於世,這無疑是科技界最具諷刺意味的黑天鵝事件。

高達五十一萬行的 Claude Code 原始碼意外流出,不僅讓 Anthropic 面臨上市前的空前危機,更向全球競爭對手直接攤牌了其 AI 軟體工程的核心底牌。

然而,撇除商業競爭與咎責的濾鏡,這場外洩案真正值得我們深究的,是隱藏在龐大程式碼背後的未來輪廓。

從這次提前曝光的未發布功能中,我們看到了「夢境機制」與「臥底模式」等令人驚嘆的設計。

這意味著 Claude Code 已經不再只是一個被動接受指令的聊天機器人,而是正在進化成具備自主推演與隱蔽作業能力的「代理型 AI」(Agentic AI)。

所謂的夢境機制,暗示了 AI 能夠在虛擬沙盒中自我模擬、測試並優化解決方案,如同人類在睡夢中重組記憶與經驗。

而臥底模式則顯示 AI 可能具備在複雜系統中默默排查漏洞,甚至不被既有安全機制察覺的高階權限。

這些功能展示了 Anthropic 在技術深度上的驚人突破,卻也同時敲響了企業資安的巨大警鐘。

正如資安業者所警告的,當代理型 AI 的自主性越高,一旦失控或遭到惡意濫用,企業將進入一個全新的防禦戰場。

過去,駭客需要親自尋找系統漏洞並手動撰寫惡意程式。

如今,有了強大的 AI 程式碼助理,攻擊者只需下達宏觀的破壞指令,AI 就能自主拆解任務、生成攻擊腳本並尋找突破口。

當 Claude Code 的底層邏輯被攤在陽光下,無論是競爭對手還是惡意組織,都能輕易窺探其決策樹與運作細節,進而找出逆向工程或植入後門的方法。

這起事件也巧妙地反映了當前 AI 資本市場的微妙板塊移動。

就在 OpenAI 歡慶完成一千兩百二十億美元的破紀錄融資、估值衝上天際的同時,市場卻傳出 OpenAI 股份在二級市場遇冷,投資人反而捧著現金爭搶 Anthropic 的股份。

OpenAI 雖然吸金能力驚人,但其旗下 Sora 模型每日高昂的算力消耗與盈利難題,正逐漸耗損市場耐心。

相比之下,Anthropic 專注於高效率、低耗能的企業級應用,其在白領市場的實用價值原本更受資本青睞。

可惜的是,這場人為疏失引發的洩密風暴,無疑對其即將到來的 IPO 計畫投下了巨大震撼彈。

科技的發展往往伴隨著脆弱性,而最大的漏洞往往不是演算法,而是按下滑鼠的那個人。

Anthropic 的外洩案是一個極具代表性的轉捩點,它向世界宣告了「代理型 AI」時代已經來臨,AI 將成為具備高度自主性的數位員工。

但同時,它也殘酷地提醒所有科技企業,在追求模型參數與自主能力的極限時,基礎的權限控管與人員防呆機制,才是守住商業護城河的最後一道防線。

未來的 AI 霸主,或許不是技術最花俏的那一個,而是能在創新與安全之間,取得最完美平衡的掌舵者。

generated_image_gemini